Robots文件是网站和蜘蛛程序之间的“君子协议”——robots文件不仅仅可以节省网站的资源,还可以帮助蜘蛛更加有效的抓取网,从而提高排名。

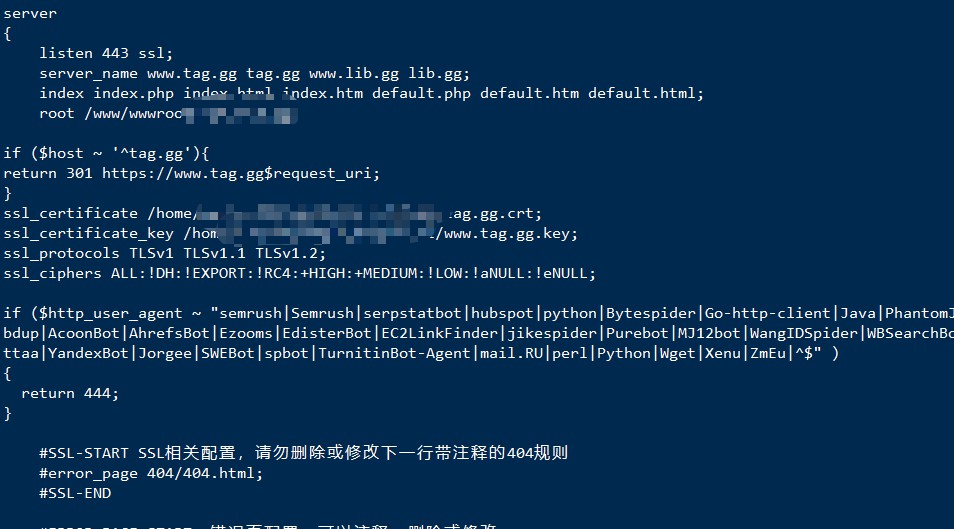

1:只允许谷歌bot

如果要拦截除谷歌bot之外的所有爬虫:

User-agent:*

disallow:/

Uer-agent:允许的蜘蛛名

Disallow:

2:“/folder/”和“/folder”的区别

举个例子:

User-agent:*

Disallow:/folder/

Disallow:/folder

“Disallow:folder/”表示拦截的是一个目录,该目录文件下的所有文件不允许被抓取,但是允许抓取folder.hlml。

“Disallow:/folder”:对/folder/下的所有文件和folder.html都不能被抓取。

3:“*”匹配任意字符

User-agent:*

表示屏蔽所有的蜘蛛。当我们做了伪静态处理之后,会同时又动态网页和静态网页,网页内容一模一样,视为镜态页面,所以我们要屏蔽掉动态的网页,可以用*号来屏蔽动态的网页

User-agent:*

Disallow:/?*?/

4:$匹配网址结束

如果要拦截以某个字符串结束的网址,就可以使用$,例如,要拦截以.asp结束的网址:

User-agent:*

Disallow:/*.asp$

也可以打开比较优秀的网站,看他们的robots文件是如何书写的,然后根据自己的需求进行相应的修改。Robots文件可以让蜘蛛把更多的时间花在要抓取的内容上,所以优化robots文件是很有必要的。

本文来自东阳高复:http://mygaofu.com,转载请注明链接

文章评论 本文章有个评论